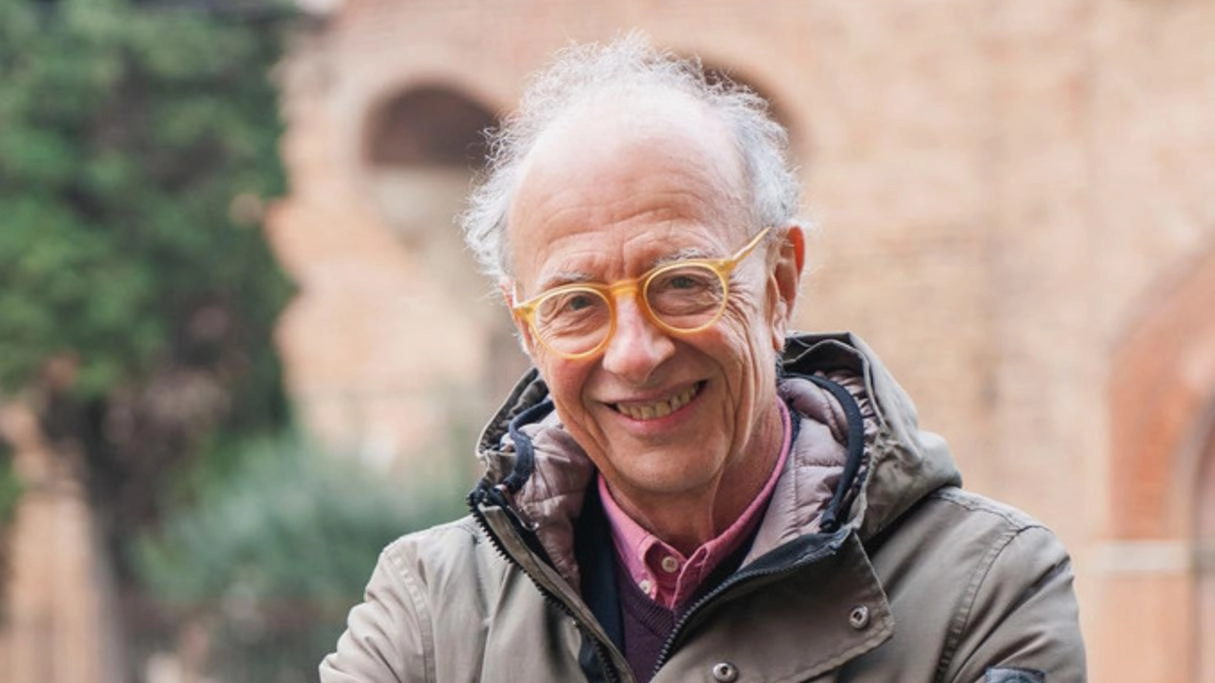

Gherardo Colombo, ex Pm italiano, analizza l'impatto dell'Intelligenza Artificiale sulla giustizia e la società, sottolineando la necessità di regole e rispetto per la dignità umana.

di Riccardo Jannello

Un uomo di legge e quindi di principi. Gherardo Colombo (il titolo di uno dei suoi ultimi scritti è emblematico: "Anche per giocare servono le regole"), ex Pm protagonista dei casi più spinosi della giustizia italiana negli anni ‘90 e poi sempre impegnato a difesa della giustizia, ha una sua idea molto profonda sui problemi della tecnologia e quindi anche dell’Intelligenza Artificiale.

Dottore, che pensa di questa rivoluzione?

"Penso che sia giusto analizzare questo fenomeno da ogni punto di vista legandolo anche alla giustizia. E penso che un progresso del genere debba essere governato, prendendo in esame tutte le possibilità che si aprono dall’utilizzo dell’IA".

Quali esempi sono più calzanti?

"Per intenderci, l’IA è utilizzata anche per la guida autonoma delle autovetture; e quindi la macchina deve prevedere la scelta da fare nel caso per esempio si trovasse in una situazione in cui se va dritta investe un pedone, se va storta gira e finisce contro un palo e provoca danni a chi è sopra. Chi ne risponde?".

Questo è un fatto pratico, ma si deve essere tutelati anche per quel che riguarda la mente?

"Ovvio che ci siano aspetti legali che riguardano la proprietà dei testi e quindi il tema, ad esempio, del plagio letterario. E c’è anche la possibilità che gli scritti creati dall’Intelligenza Artificiale riguardino temi come la diffamazione e la responsabilità giuridica. Come si vede ci sono tanti aspetti che si incrociano e che dobbiamo affrontare".

Il progresso tecnologico è ineludibile?

"Essere contro è superficiale. Tutte le volte che si è scoperto qualcosa che aumentasse le possibilità dell’essere umano ci siamo trovati di fronte a uno strumento che è stato utilizzato nel bene e nel male: bisogna saperlo governare. Pensiamo alla bomba atomica e al percorso fatto in precedenza. Si tratta dell’ultimo prodotto di una catena che è cominciata dall’uso delle mani nude e poi dei sassi, della clava e via via fino ad esempio al coltello. Sia questo, sia l’atomo possono essere usati per usi civili ma anche come elemento di violenza".

Come si impedisce?

"Talvolta discutiamo sulla legittimità delle nostre azioni e anche la violenza entra in questi pensieri. Così è per l’Intelligenza Artificiale: lo scopo per cui si usa lo strumento è il problema, il dibattito deve vertere su quello".

L’uomo sa discernere come usare nuovi mezzi?

"Purtroppo c’è chi usa internet per commerciare droga e chi per allertare le persone che sta arrivando uno tsunami. La nuova scoperta avrà lo stesso effetto".

La parola regola per lei è un mantra: la prima che metterebbe sull’Intelligenza Artificiale?

"Quella che guida la nostra Costituzione: il rispetto della dignità delle persone. Regola che i social troppo spesso dimenticano".

Lei pensa che i vantaggi saranno maggiori degli svantaggi?

"Io penso che se rispettiamo la persona possiamo pacificare tutte le cose, utilizzare questo strumento ad esempio per redistribuire le retribuzioni o aiutare nelle indagini per un caso di omicidio".

Non ha paura che l’Intelligenza Artificiale possa portare a una perdita di manodopera?

"Quando è arrivata l’automobile tanti vetturini e stallieri hanno perso il lavoro, ma si sono create nuove possibilità di occupazione. Accade così in ogni momento di progresso o quando cambia il mercato: i cd sono scomparsi ma è nato qualcosa di altro a sostituirli".

Un problema basilare è la formazione delle maestranze: dovrà essere il pubblico o il privato a provvedere?

"Dobbiamo prendere insegnamento da quello che è già accaduto nel passato. Sicuramente la maggior parte competerà alle strutture pubbliche, ma anche il privato se vorrà stare al passo coi tempi dovrà agire".

Insomma, non si può fuggire alle rivoluzioni...

"A quella scientifica no, è indispensabile: ci sarà anche chi pensa il contrario, ma rimane fuori dal tempo".